Cerebras et Abu Dhabi construisent le modèle d’IA en langue arabe le plus puissant au monde

https://auth.inceptioniai.org/realms/IIAI_CHAT/protocol/openid-connect/auth?client_id=4kcbas7ohjr2c9qg3ze5dp1ni8tmvfwx&redirect_uri=https://arabic-gpt.ai/&response_type=code&scope=openid&state=deb8cb2d155e40cb940df1d832736788&code_challenge=wtKLRelHYfkMth_L6-6WFrAdPXzxVLL6L60xuTvX_kM&code_challenge_method=S256&response_mode=query

Jais-Chat, nommé d’après la plus haute montagne des Émirats arabes unis, peut prendre un message en arabe ou en anglais et compléter la phrase, tout comme le fait Chat-GPT. Tiernan Ray + DreamStudio de Stability.ai

Signe des temps à venir, la startup Cerebras Systems vient d’annoncer une association avec Inception, une filiale de la société d’investissement G42 des Émirats arabes unis. L’idée est de créer le plus grand modèle linguistique ouvert au monde pour l’arabe, une langue parlée par environ 400 millions de personnes.

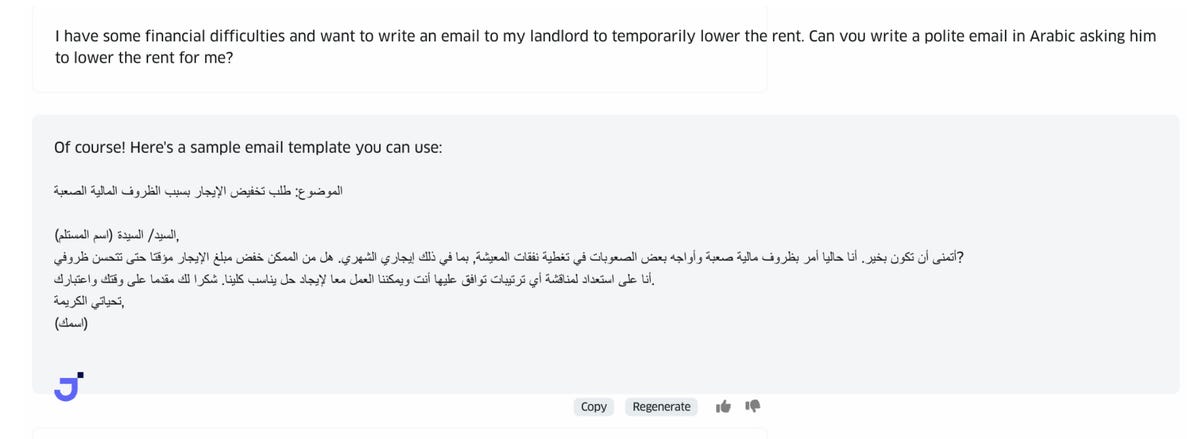

L’utilisation du programme, appelé Jais-Chat, se fait de la même manière que la saisie dans l’invite de Chat-GPT, à ceci près que Jais-Chat peut prendre et produire des textes en arabe en entrée et en sortie. Il peut, par exemple, écrire une lettre en arabe lorsqu’on lui demande de le faire en anglais :

Inception

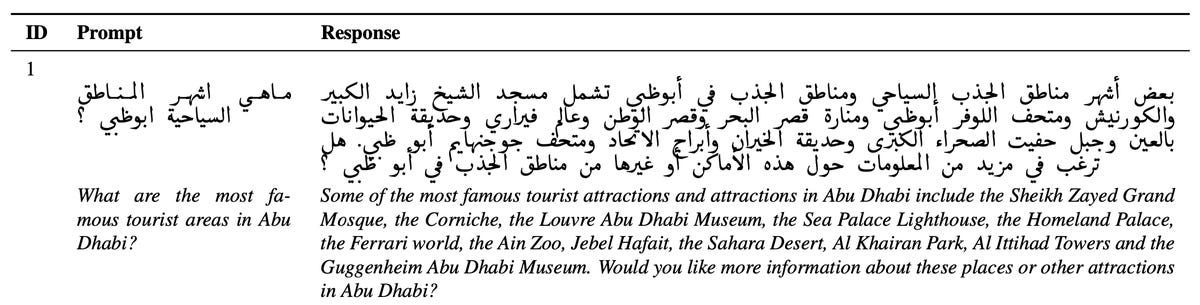

Ou il peut prendre une invite en langue arabe et générer une réponse en arabe :

Inception

Entraîné sur un corpus spécial de textes arabes important, le programme renonce à l’approche typique qui consiste à construire un programme généraliste qui traite des centaines de langues, dans de nombreux cas de manière médiocre, et se concentre exclusivement sur les traductions anglaises et arabes.

publicité

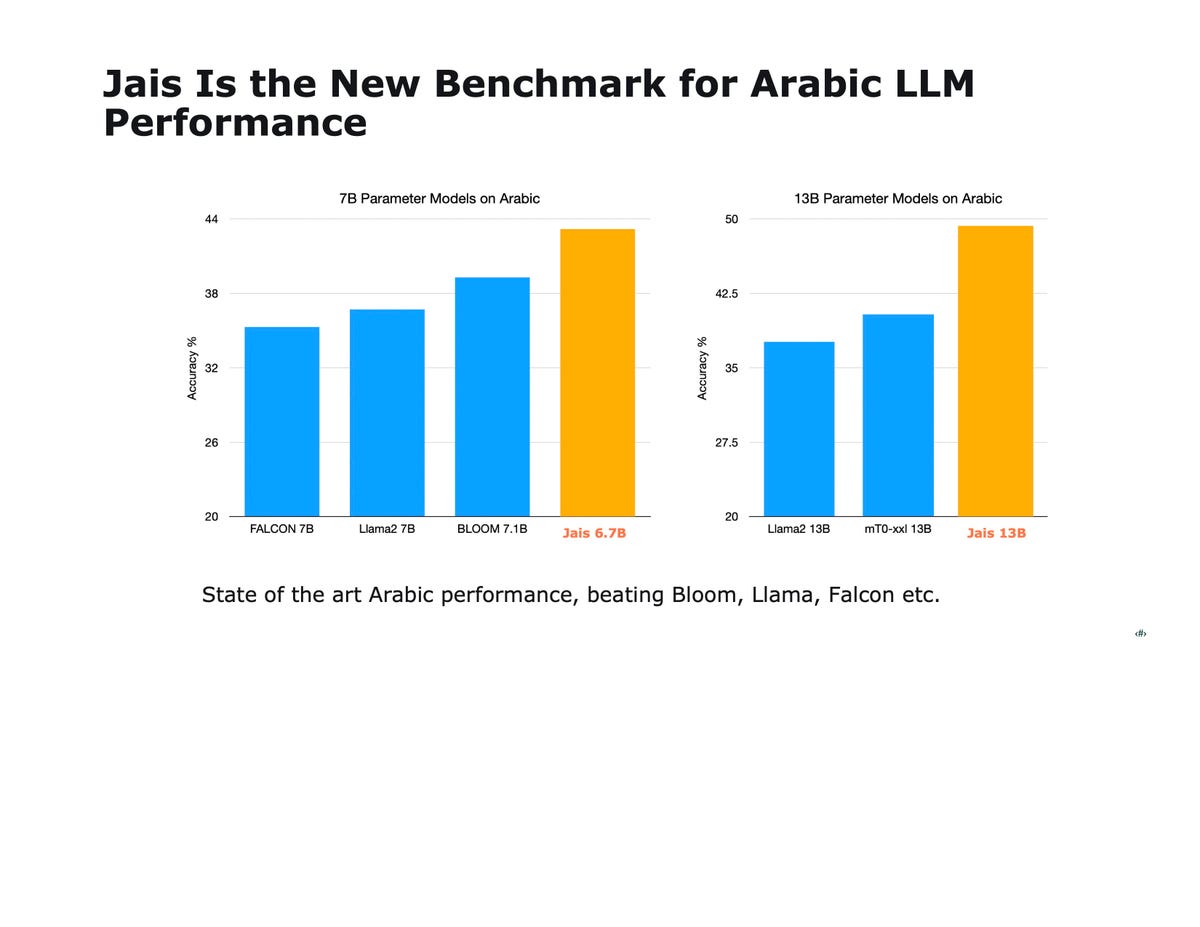

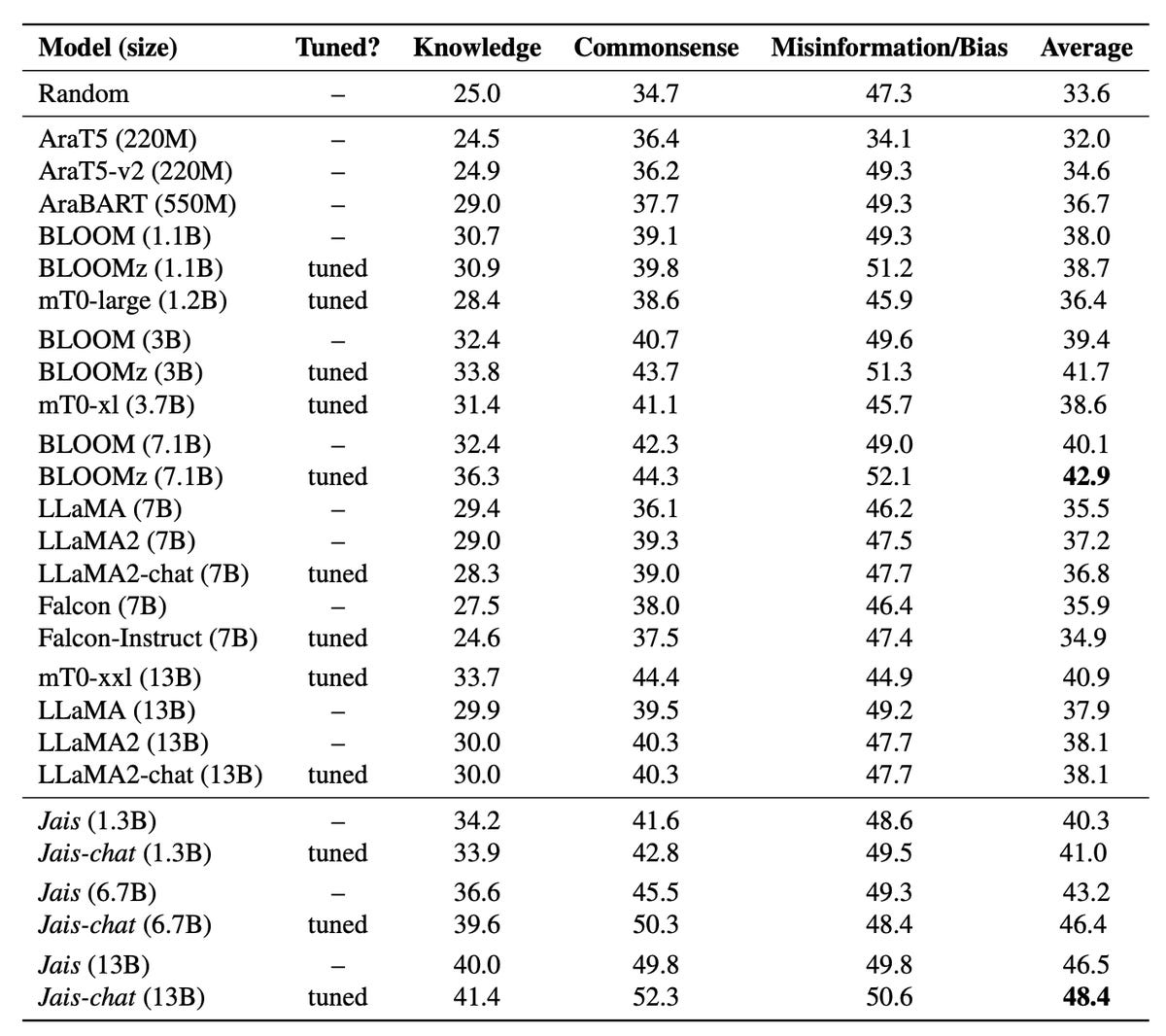

Jais-Chat a obtenu 10 points de plus que LlaMA 2

Lors de tests – tels que le test QCM MMLU de l’Université de Californie à Berkeley, et le test HellaSwag de l’Institut Allen pour l’IA – Jais-Chat a obtenu 10 points de plus que les principaux LLM tels que LlaMA 2 de Meta. Il a battu les meilleurs programmes open-source tels que Bloom de Big Science Workshop de cette année, et il a également battu les modèles de langage spécialisés construits exclusivement pour l’arabe.

plus performant pour traiter les contextes très longs, c’est-à-dire les entrées d’un modèle linguistique tapées à l’invite ou rappelées de la mémoire.

Le code de Jais est publié sous licence Apache 2.0 et est disponible sur Hugging Face

“Nous cherchions à saisir les nuances linguistiques de l’arabe et les références culturelles”, explique M. Feldman, qui a beaucoup voyagé au Moyen-Orient. “Et ce n’est pas facile quand la majeure partie du modèle est en anglais”.

Grâce à ces modifications, le résultat est un modèle linguistique appelé Jais, et son application de chat, Jais-Chat, mesurant 13 milliards de “paramètres”, les poids neuronaux qui forment les éléments actifs critiques du réseau neuronal. Jais est basé sur l’architecture GPT-3 conçue par OpenAI, une version dite “décodeur” du Transformer de Google datant de 2017.

Le code du programme Jais est publié sous la licence de code source Apache 2.0 et est disponible au téléchargement sur Hugging Face. Une démonstration de Jais peut être utilisée en s’inscrivant sur une liste d’attente. Les auteurs prévoient de rendre l’ensemble de données public “dans un avenir proche”, selon M. Feldman.

Les programmes ont été exécutés sur ce que Cerebras appelle “le plus grand supercalculateur au monde pour l’IA”, appelé Condor Galaxy 1, qui a été construit pour G42 et a été dévoilé le mois dernier.

La machine est composée de 32 ordinateurs d’IA spécialisés de Cerebras, les CS-2, dont les puces contiennent collectivement un total de 27 millions de cœurs de calcul, 41 téraoctets de mémoire et 194 trillions de bits par seconde de bande passante. Ils sont supervisés par 36 352 processeurs de serveur EPYC x86 d’AMD. Les chercheurs ont utilisé une partie de cette capacité, soit 16 machines, pour former et “affiner” Jais.

Avec ses 13 milliards de paramètres, le programme est très performant. Il s’agit d’un réseau neuronal relativement petit, comparé à des éléments tels que le GPT-3, qui compte 175 milliards de paramètres.

“Ses capacités pré-entraînées surpassent tous les modèles arabes open-source connus”, écrivent les chercheurs, “et sont comparables aux modèles anglais open-source qui ont été entraînés sur des ensembles de données plus importants”.

Comme le notent les auteurs, l’ensemble de données arabes de 72 milliards de tokens ne serait normalement pas suffisant pour un modèle de plus de 4 milliards de paramètres, selon la règle empirique de l’IA connue sous le nom de “loi de Chinchilla”, formulée par les chercheurs de DeepMind de Google.

En fait, non seulement Jais-Chat dans sa forme à 13 milliards de paramètres surpasse LlAMA 2, mais dans une version plus petite de leur programme avec seulement 6,7 milliards de paramètres, ils sont également en mesure d’obtenir de meilleurs résultats aux mêmes tests tels que MMLU et HellaSwag.